Vaizdų skaitymas ir objektų atpažinimas vaizduose yra svarbi užduotis ir iššūkis apdorojant vaizdus ir matant kompiuterį. Paprasta „automatinio objektų atpažinimo“ paieška „Google“ mokslininke suteiks jums ilgą straipsnių sąrašą, kuriame pateikiamos įvairiausios sudėtingos lygtys ir algoritmai, pradedant 90-ųjų pradžia iki dabar. Tai reiškia, kad ši tema nuo pat paieškos pradžios buvo labai intriguojanti šios srities tyrinėtojus, tačiau vis dar yra darbas, kuris, atrodo, vyksta.

Ne taip seniai mes jus įtraukėme į „Google“ vaizdų paieškos pasaulį, atlikdami išsamų atvejo tyrimą . Tada mes bandėme išsiaiškinti, ar „Google“ gali nuskaityti tekstą iš vaizdų ir kokia šio dalyko reikšmė SEO pasauliui. Grįžome su įdomiais tyrimais tame pačiame „vaizdų paieškos“ lauke, kuriame bandoma atkreipti dėmesį į „Google“ pažangą šioje srityje ir į tai, kaip SEO specialistas turėtų neatsilikti, kad ateityje būtų geresnis reitingas.

Ateitis priklauso tiems, kurie jai šiandien yra pasirengę! Artimiausiu metu „Google“ tikriausiai pakeis algoritmus, susijusius su vaizdų reitingavimu, pokyčius, kurie dramatiškai paveiks paiešką, taigi ir SEO pasaulį.

Tai nėra menkas algoritmo pakeitimas, apie kurį kalbame, vienas iš tų, kurie daro įtaką tik nedidelei paieškos daliai. Ar kito lygio vaizdų paieškos karta, su kuria susidursime? Tai neabejotinai bus sėkminga paieškos pramonės pažanga, tačiau tikroji sėkmė bus tiems, kurie žengė žingsnį į priekį ir jau buvo pasirengę šiems dideliems pokyčiams.

Kodėl skaitmeninės rinkodaros bendruomenei objektų atpažinimas vaizduose yra svarbus?

Dienos pabaigoje viskas priklauso nuo reitingų.

Objektų aptikimas vaizduose pridės papildomą reitingavimo signalų sluoksnį, kurio negalima lengvai pakeisti.

Vaizdas su mėlynu šunimi bus vertinamas pagal su mėlynu šunimi susijusį raktinį žodį, o ne pagal raudoną šunį. Tai turi dvi svarbias pasekmes SEO pramonei:

1. Ieškant konkretaus raktinio žodžio pasirodys mažesnis klaidingų teigiamų žodžių skaičius, atsižvelgiant į tai, kas iš tikrųjų yra paveikslėlyje.

2. Be to, jis gali būti naudojamas susieti puslapio turinį su tikruoju vaizdu be jokių kitų išorinių veiksnių. Jei puslapyje yra daug mėlynų šunų nuotraukų ir įvairių kitų dalykų, susijusių su šunimis, tai automatiškai sustiprina to puslapio, kuriame kalbama apie šunis, reitingą.

Vis dėlto gali kilti klausimas:

Ar tai gali būti nauja objektų užpildymo vaizdais era kaip šešėlinė SEO technika?

Nemanau, nes šiais laikais algoritmai yra gana pažangūs, kad būtų galima aptikti tokio pobūdžio šlamštą. Tačiau tai neabejotinai naujos kartos paieškos, apie kurias kalbame, kurios gali sukelti didelių pokyčių ir iššūkių SEO pasaulyje.

„Google“, dirbtinis intelektas ir vaizdų supratimas

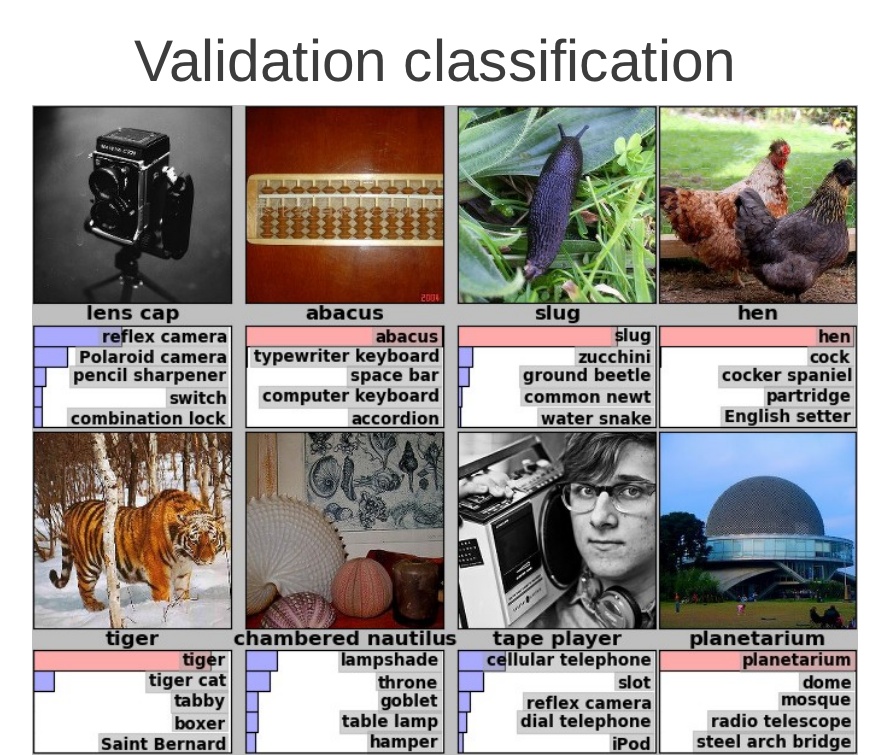

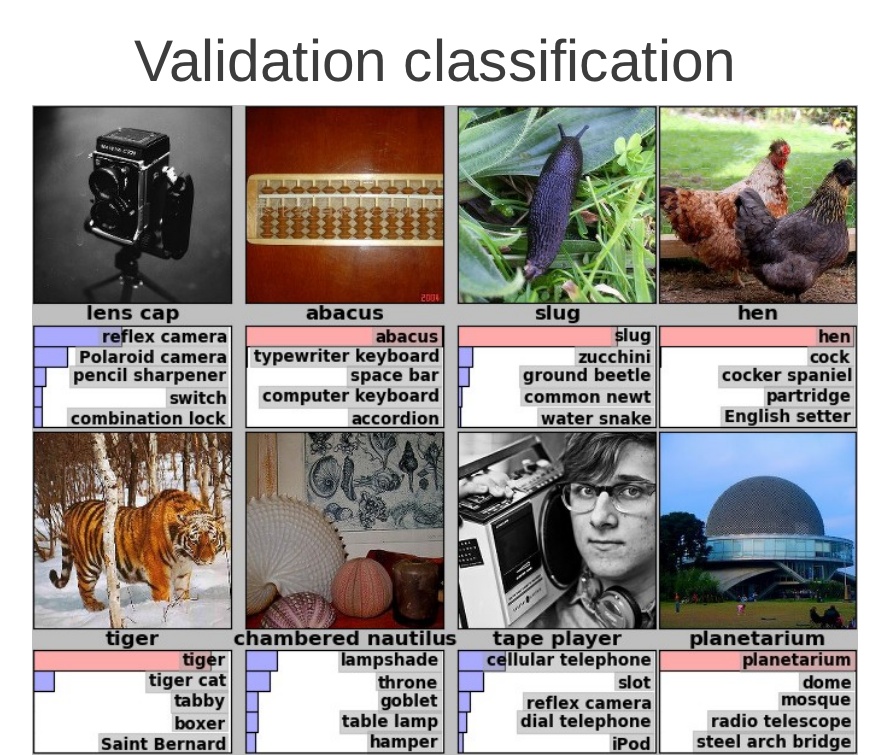

Vaizdo supratimas yra gana didelis dalykas visiems, todėl vizualinio atpažinimo iššūkis egzistuoja nuo 2010 m. Jis vadinamas „ ImageNet Large Scale Vision Recognition Challenge“ (arba ILSVRC) ir yra puikus pavyzdys, kaip konkurencija skatina pažangą. ILSVRC yra trys pagrindiniai takeliai : klasifikacija, klasifikacija su lokalizacija ir aptikimas. Tai reiškia, kad algoritmai, kurie yra įvesti į šį ginčijamą objektą, yra tikrinami atsižvelgiant į tai, ar jie gerai atpažįsta objektus tam tikrame paveikslėlyje, ir tai, ar jie „supranta“, kur objektas yra paveikslėlyje.

Kad būtų pasiektas aukštesnis našumas aptikimo iššūkyje, pramonė reikalauja daugiau nei komentuoti vaizdą „ etikečių maišeliu “, tikėdamasi, kad kažkas prilips.

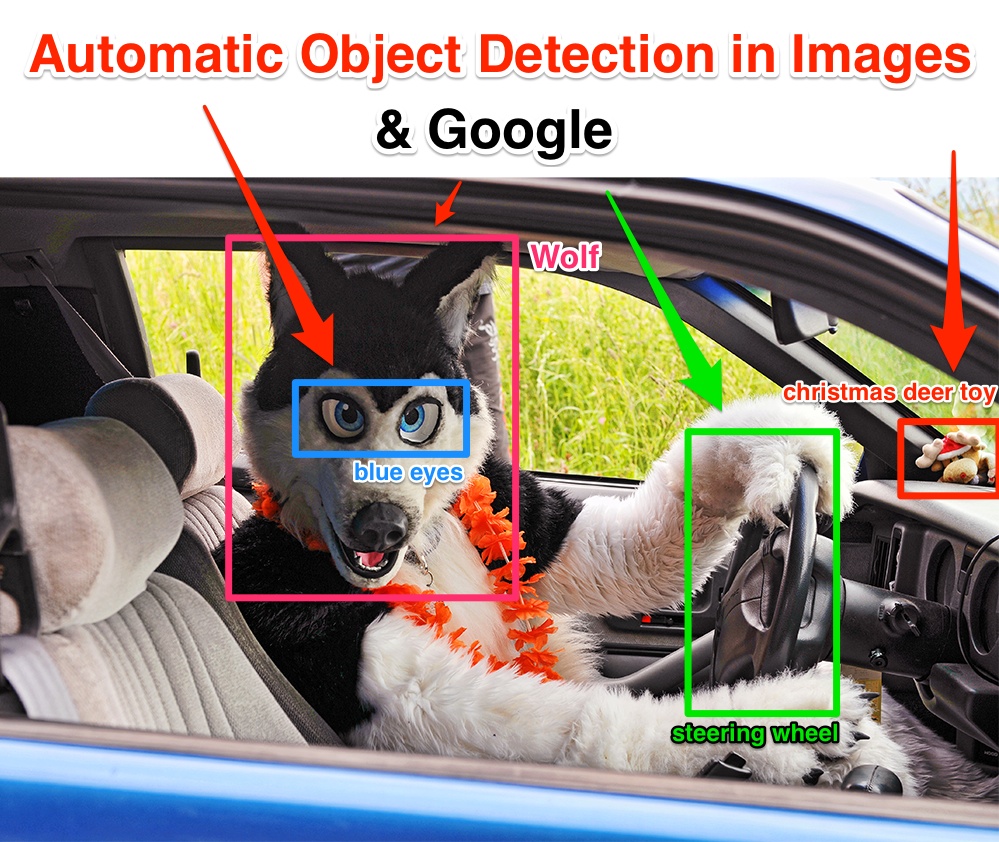

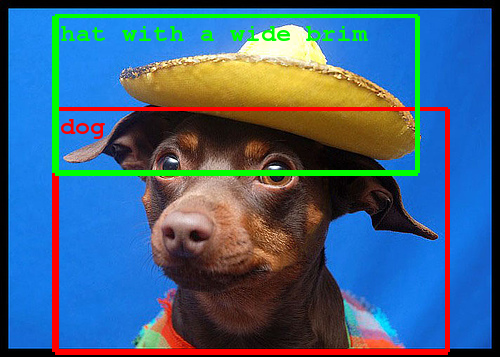

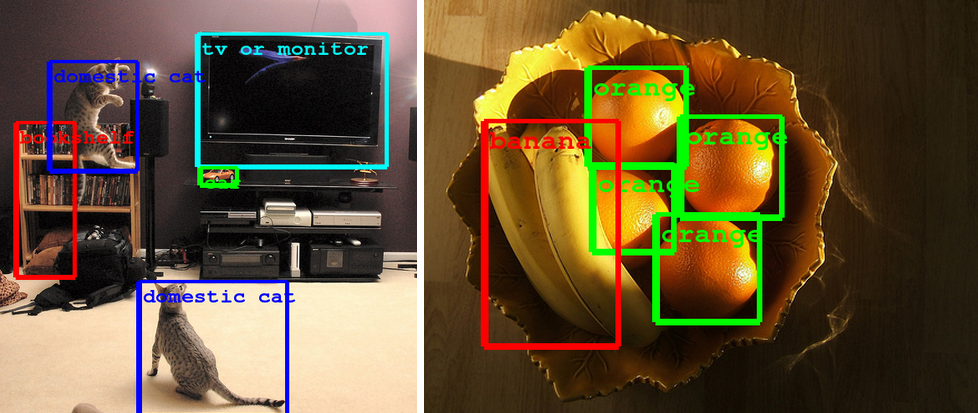

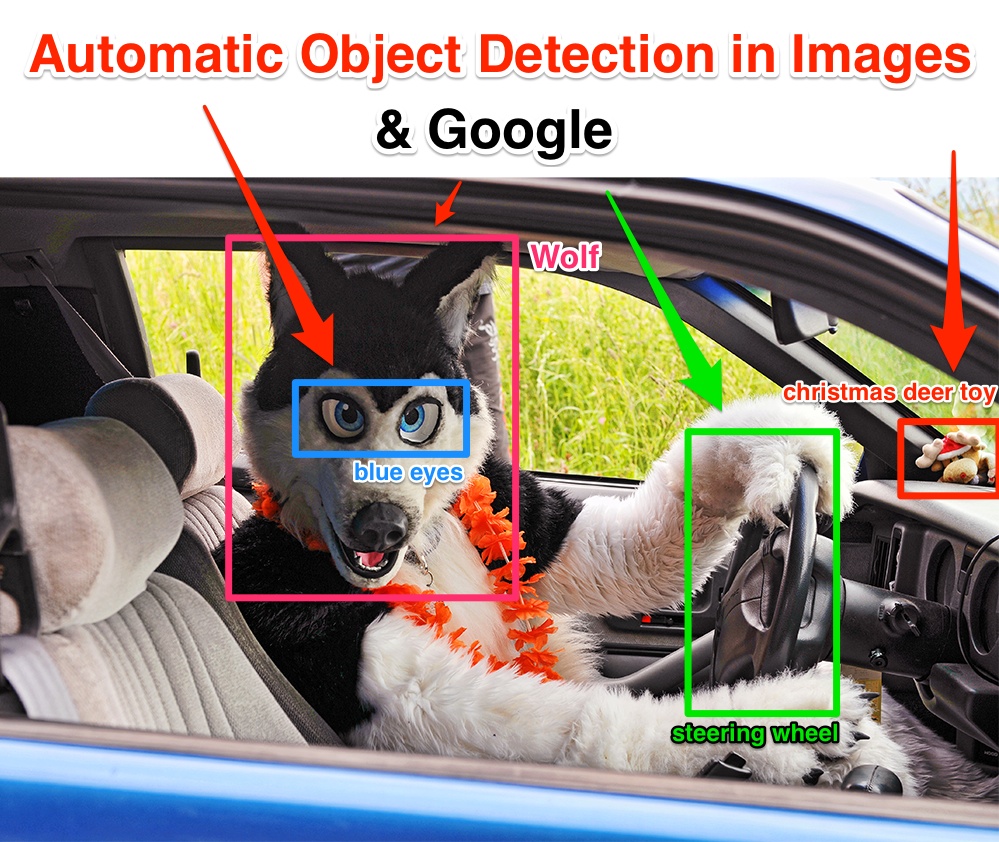

Kad algoritmas galėtų sėkmingai atlikti šį iššūkį, jis turi sugebėti apibūdinti sudėtingą sceną tiksliai nustatydamas ir nustatydamas joje daug objektų. Tai reiškia, kad, atsižvelgiant į mopedu važiuojančio asmens nuotrauką, programinė įranga turėtų sugebėti ne tik atskirti kelis atskirus objektus (pvz., Mopedą, asmenį ir šalmą), bet ir teisingai pastatyti juos į erdvę ir teisingai juos klasifikuoti. Kaip matome paveikslėlyje, atskiri daiktai yra teisingai identifikuoti ir klasifikuojami.

Ekrano nuotrauka paimta iš http://googleresearch.blogspot.ro/2014/09/building-deeper-understanding-of-images.html

Bet kuri paieškos sistema, turinti tokią galimybę, labai apsunkintų bandymą perduoti žmonėms, važiuojantiems mopedais, kaip „lenktynininkų, vairuojančių„ Porsche ““ nuotraukas, prikimšdama metaduomenų, kuriuose taip sakoma. Kaip matote toliau pateiktuose pavyzdžiuose, technologija yra gana pažangi ir bet kokia klaidinanti schema gali būti lengvai atskleista.

Ekrano nuotrauka paimta iš http://googleresearch.blogspot.ro/2014/09/building-deeper-understanding-of-images.html

Šiais metais „Google“ dalyvavo ILSVRC, kur laimėjo su savo komanda „GoogleLeNet“ ir padarė kodą atvirą šaltinį, kad galėtų juo pasidalinti su bendruomene ir greičiau plėtoti technologijas. Tai turi milžinišką reikšmę pažangos požiūriu, nes „ILSVRC 2014“ jau yra šimtus ir net tūkstančius kartų sudėtingesnė nei panašių objektų aptikimo iššūkis vos prieš 2 metus. Net per vienerius metus šių metų laimėjimas šiame konkurse, atrodo, yra daug didesnis nei praėjusiais metais: surinkti 60 658 nauji vaizdai ir visiškai anotuoti 200 objektų kategorijų, suteikiant 132 953 naujas aprišimo dėžės anotacijas, palyginti su 2013 m. . Tikiuosi, kad lygtyje nepateiksiu per daug duomenų, tai reiškia, kad 2013 m. Vaizdo skaičius buvo apie 395000, o tik po metų skaičius gerokai padidėjo iki maždaug 457000. Taip, tai skamba taip pat susukta ir įspūdingai kaip „Google“ duomenų centras, kurį galite pamatyti žemiau esančiame paveikslėlyje.

„Google“ duomenų centras

Šiemet laimėjęs algoritmas naudoja „ Distbelief“ infrastruktūrą, kuri ne tik labai kompleksiškai žiūri į vaizdus ir gali identifikuoti objektus, neatsižvelgiant į jų dydį ir padėtį paveikslėlyje, bet ir mokosi. Tai nėra pirmas ir vienintelis kartas, kai „Google“ sutelkia dėmesį į mašininio mokymosi technologijas, kad viskas būtų geriau. Praėjusiais metais Andrew Ng, Stanfordo universiteto Dirbtinio intelekto laboratorijos direktorius ir buvęs „Google“ darbo tyrimų grupės „Google X“ kviestinis mokslininkas, pasiūlė architektūrą, galinčią mokyti ir augti:

„Mūsų sistema per porą dienų gali mokyti 1 milijardą parametrų tinklų tik 3 mašinose ir mes parodome, kad naudojant tik 16 mašinų ji gali būti išplėsta į tinklus, turinčius daugiau nei 11 milijardų parametrų.“

„Google+“ jau naudoja objektų aptikimą vaizduose. „Google“ paieška Kitas?

Tiesą sakant, išmanusis vaizdo aptikimo algoritmas, pagrįstas konvoliuciniu neuroninio tinklo architektūra, „Google+“ jau naudojamas daugiau nei metus . Dalis „ImageNet“ iššūkyje pateikto kodo buvo naudojama paieškos sistemos algoritmams patobulinti ieškant konkrečių (tipų) nuotraukų, net jei jos nebuvo tinkamai paženklintos.

Neuroninio tinklo architektūra gyvuoja nuo 1990-ųjų, tačiau tik neseniai tiek modeliai, tiek mašinos yra pakankamai efektyvūs, kad algoritmai veiktų milijardus vaizdų vienu metu. Pažangą galima kiekybiškai įvertinti įvairiais būdais, tačiau atsižvelgiant į vartotojo patirtį, reikia nepamiršti kelių dalykų:

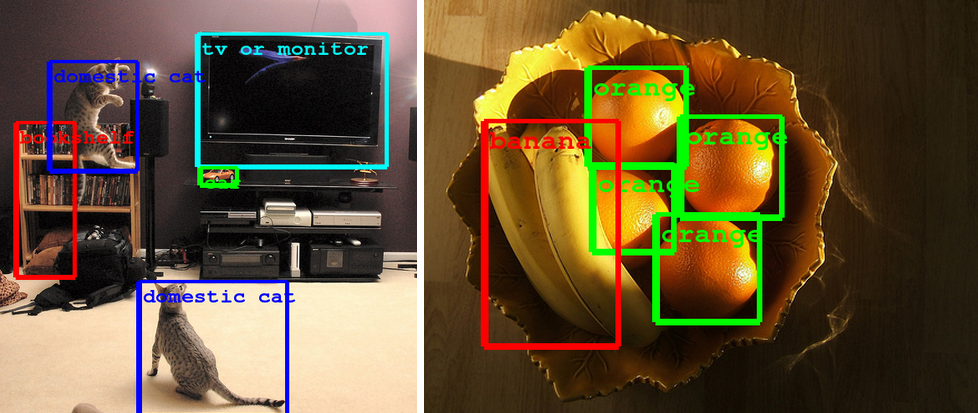

1. Pirma, „Google“ algoritmas įrodė, kad gali pritaikyti objektus iš žiniatinklio vaizdų (iš arti, dirbtinę šviesą, išsamią) su objektais iš nestadijuotų nuotraukų (vidurio žemė, natūrali šviesa su šešėliais, įvairaus lygio detalės). Gėlė atrodė tiek pat gėlė pagal bet kokią kitą skiriamąją gebą ar apšvietimo sąlygas.

2. Be to, didžiajam G pavyko nustatyti keletą labai specifinių vaizdinių klasių, išskyrus bendrąsias. Tai ne tik nustatė daugumą gėlių kaip gėles, bet ir tam tikras specifines gėles (pvz., Hibiską ar jurginą).

3. „Google“ algoritmai taip pat sugebėjo gerai susitvarkyti su abstraktesnėmis objektų kategorijomis, atpažindami sąžiningą ir įvairų skaičių nuotraukų, kurias, pavyzdžiui, galima būtų priskirti „šokiui“, „valgiui“ ar „bučiniui“. Tam reikia daug daugiau, nei paprasčiausiai aptikti apelsiną kaip apelsiną.

Ekrano nuotraukos paimtos iš http://googleresearch.blogspot.ro/2013/06/improving-photo-search-step-across.html

4. Taip pat buvo gerai elgiamasi su įvairiarūšės išvaizdos klasėmis. „Automobilis“ nebūtinai yra abstrakti sąvoka, tačiau gali būti šiek tiek keblu. Ar tai automobilio nuotrauka, jei galime pamatyti visą automobilį? Ar automobilio vidus vis dar yra automobilio vaizdas? Mes sakytume „taip“ ir atrodo, kad atrodo ir naujasis „Google“ algoritmas.

5. Naujasis modelis nėra be nuodėmės. Tai daro klaidų. Tačiau svarbu pažymėti, kad net kalbant apie klaidas, jos rodo pažangą. Atsižvelgiant į tam tikrą kontekstą, tikslinga suklaidinti asilo galvą su šuns galva. Arba šliužas gyvatei. Net ir per klaidą dabartinis „Google“ algoritmas viršija ankstesnius algoritmus.

Ekrano nuotraukos paimtos iš http://googleresearch.blogspot.ro/2013/06/improving-photo-search-step-across.html

Ar „Google“ žinių diagrama ir vaizdų aptikimas yra „santuoka“?

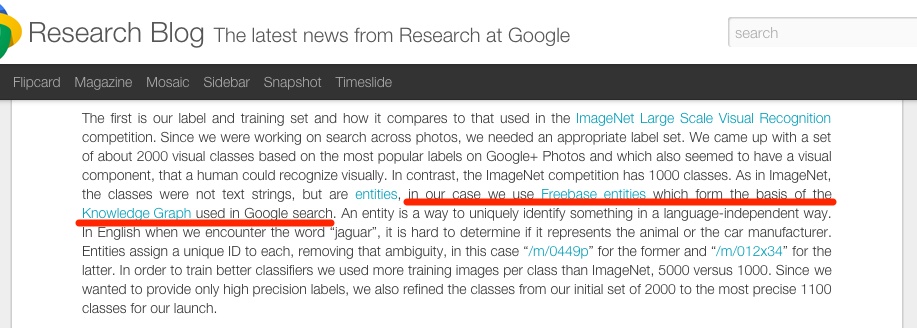

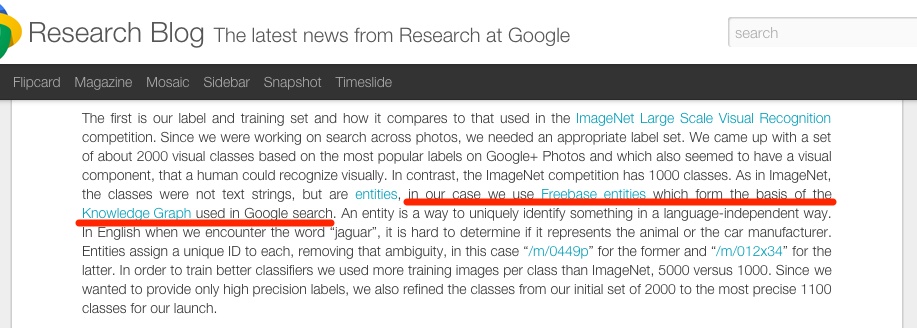

Kad ir koks įspūdingas yra naujasis „Google“ modelis, jis dar įspūdingesnis yra tai, kad tai tik dalis didesnio mokymosi mašinų paveikslo, puikiai integruoto su jau įspūdingu savo paties žinių grafiku. Pastarųjų pagrindą sudarančios „esybės“ taip pat padeda formuoti vaizdo aptikimo algoritmo klasifikavimo ir aptikimo galimybes. Kiekvienam objektui ir objektų klasei suteikiamas unikalus kodas (taigi, pavyzdžiui, jaguaro – gyvūno niekada negalima supainioti su „Jaguar“ – automobiliu), tada jis naudojamas padėti algoritmui mokytis, suteikiant jam žinių bazę kurį išbandyti jo bandymus.

„Google“ paverčia paiešką tuo, kas supranta ir paverčia jūsų žodžius ir vaizdus realaus pasaulio objektais, apie kuriuos kalbate.

Teisingai! Tai ne tik generuoja rezultatus pagal konkrečius žodžius ar vaizdus, bet ir tikrai „supranta“ jus.

Ekrano nuotrauka paimta iš http://googleresearch.blogspot.ro/2013/06/improving-photo-search-step-across.html

Kaip objektų aptikimas vaizduose gali paveikti jūsų SEO

Šie technologiniai laimėjimai leis mums dar geriau suprasti vaizdus, o pažanga yra tiesiogiai perduodama „Google“ produktams, pvz., Nuotraukų paieškai, vaizdų paieškai, „YouTube“, savaime vairuojantiems automobiliams ir bet kur, kur naudinga suprasti, kas yra paveikslėlyje. taip pat kur viskas yra. @GoogleResearch

Ekrano nuotrauka paimta iš http://googleresearch.blogspot.ro/2014/09/building-deeper-understanding-of-images.html

Kalbant apie paprastą SEO, šis žingsnis yra didžiulis ir jis padės sustiprinti „Google“ viziją apie SEO, pagrįstą turinio kokybe. Kaip vis sunkiau apgauti paieškos variklį naudojant įvairias susiejimo schemas, gali būti gana sunku apgauti ją netinkamai pažymėtomis nuotraukomis ar dideliu jų kiekiu. Geras turinys (ty kokybiški paveikslėliai, aiškiai identifikuoti objektai, aktualios nuotraukos) greičiausiai taps pakankamai svarbūs ir kalbant apie vaizdinius objektus.

Tikėtina, kad žymėjimas žymiai labiau priklausys nuo fotografijos kompozicijos, o ne rankinio ar dirbtinio ženklinimo. Jei norite, kad jūsų nuotrauka būtų rodoma, kai žmonės ieško „geltonojo šuns“ atvaizdų, jūsų SEO turėsite pradėti nuo to, kaip darote nuotrauką ir ką įdėjote į tą paveikslėlį.

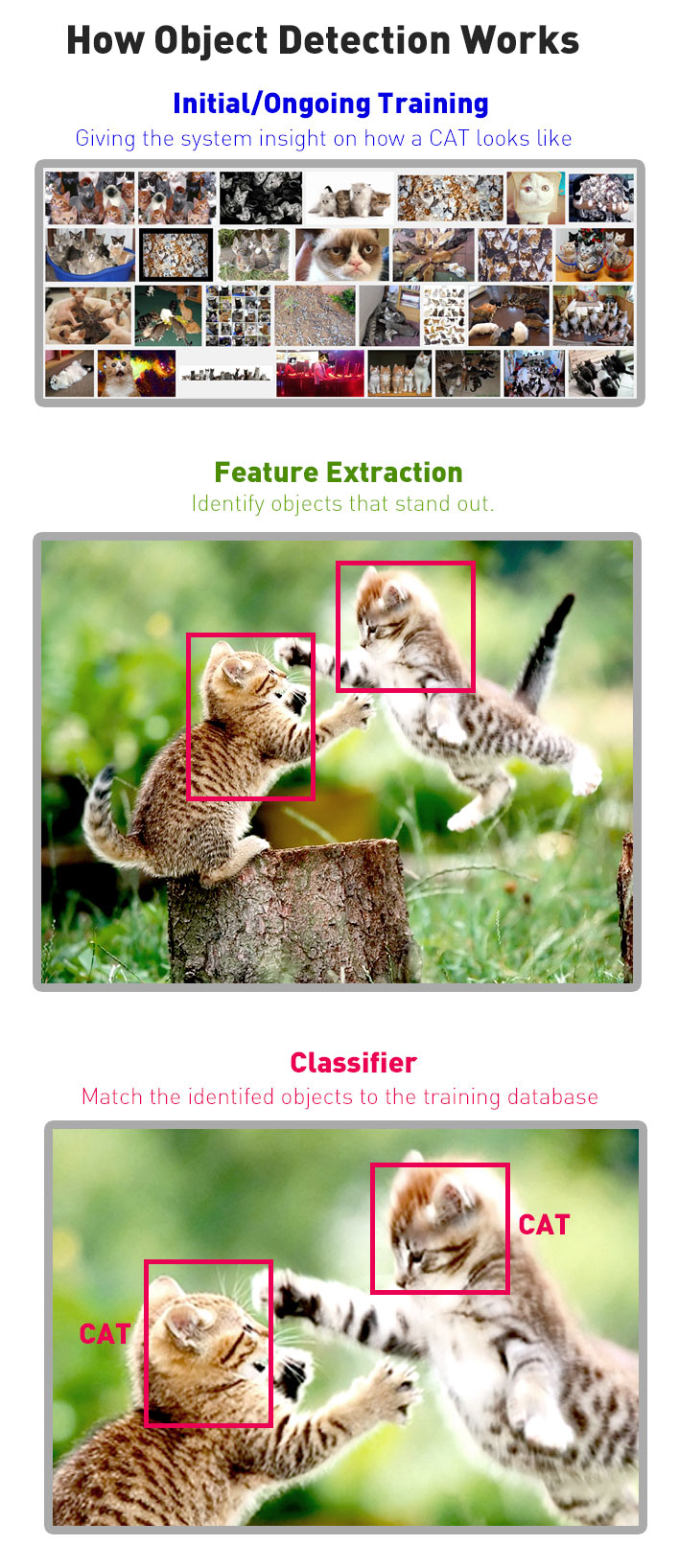

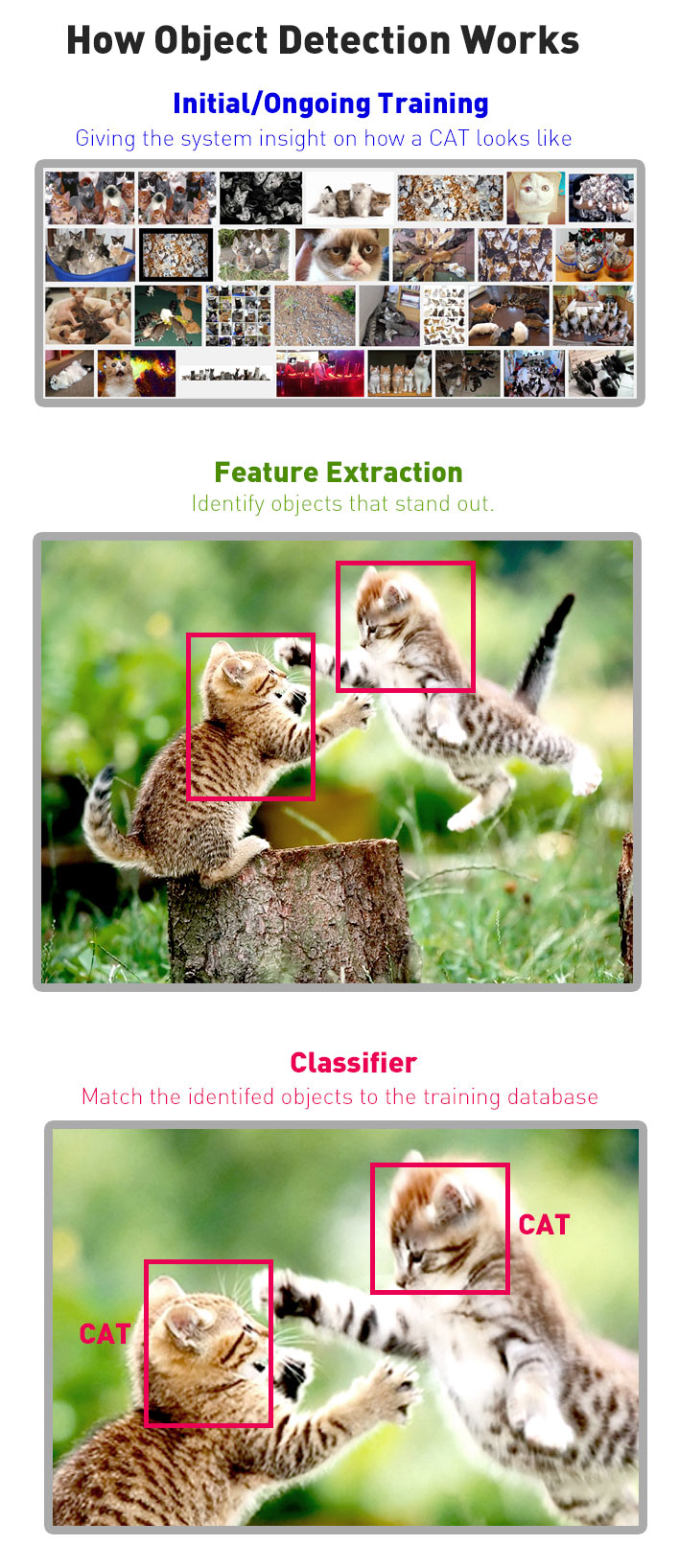

Kaip iš tikrųjų veikia objektų aptikimas vaizduose

Jei dar to nepadarėte, laikas paimti kavos puodelį ir atsinešti mane, kol mes trumpai keliausime į „geekų teritoriją“.

Taigi, kuo ypatinga „DistBelief“ infrastruktūra? Tiesus atsakymas yra tas, kad tai leidžia mokyti neuroninius tinklus paskirstytu būdu ir yra grindžiamas Hebbiano principu ir masto nekintamumo principu .

Vis dar sumišęs? Taip, ten yra supakuota daug matematikos, tačiau ją galima išpakuoti paprastesniu lygiu. Neuroniniai tinklai iš tikrųjų nurodo tai, ko jūs galėtumėte tikėtis – kaip mūsų smegenyse yra laidai. Taigi, kalbėdami apie juos, mes iš tikrųjų turime omenyje dirbtinius neuroninius tinklus (ANN), kurie yra skaičiavimo modeliai, pagrįsti mokymosi ir modelio atpažinimo idėjomis – turi prasmę kontekste, apie kurį kalbame, tiesa? Toliau pateiktas pavyzdys, kaip veikia objektų aptikimas, gali šiek tiek apšviesti šį gana sunkiai suprantamą lauką.

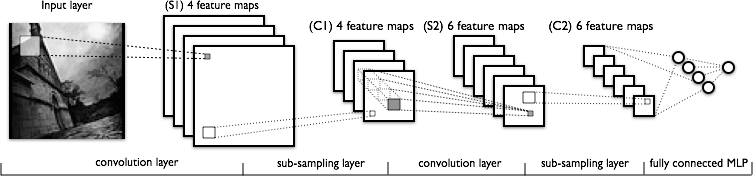

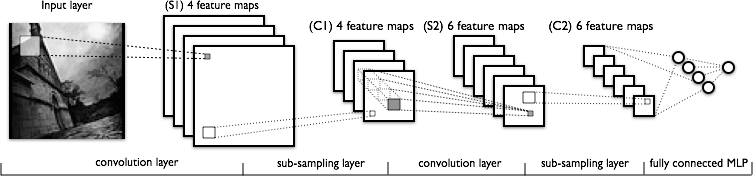

„GoogLeNet“ naudojo tam tikrą ANN tipą, vadinamą konvoliuciniu neuroniniu tinklu, kuris pagrįstas idėja, kad atskiri neuronai reaguoja į skirtingus (bet sutampančius) regėjimo lauko regionus ir kad juos galima iškloti plytelėmis, kad gautų sudėtingesnį vaizdą. Grubiai supaprastinti – tai šiek tiek panašu į darbą su sluoksniais. Viena iš konvoliucinio neuroninio tinklo privilegijų yra ta, kad jis labai palaiko vertimą. Matematikoje vertimas gali reikšti bet kokį objekto judėjimą iš vienos vietos į kitą. Taigi, jei mes sujungsime viską, ką žinome iki šiol, „Netikėjimas“ gana gerai atpažįsta objektą, kad ir kur jis būtų įdėtas į tam tikrą paveikslą. Tai gali padaryti ir daugiau. Skalės nekintamumas taip pat yra matematinis principas ir iš esmės jis teigia, kad objektų savybės nesikeičia, jei ilgio skalės padauginamos iš bendro koeficiento. Tai reiškia, kad „Netikėjimas“ turėtų gerai mokėti atpažinti apelsiną, neatsižvelgiant į tai, ar jis yra toks pat didelis kaip jūsų ekranas, ar toks mažas, kaip piktograma: jis vis tiek bus oranžinis ir bus pripažintas tokiu (taip, apelsinams!

Ekrano nuotrauka paimta iš http://deeplearning.net/tutorial/lenet.html

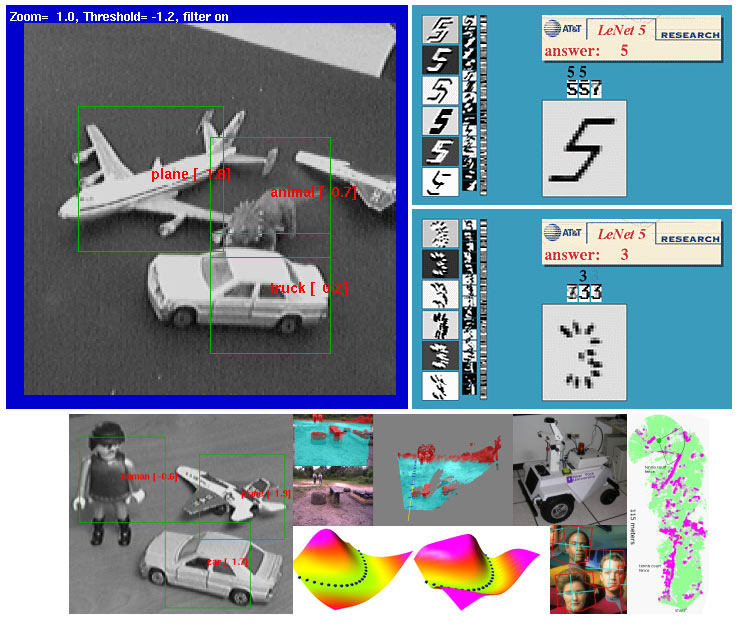

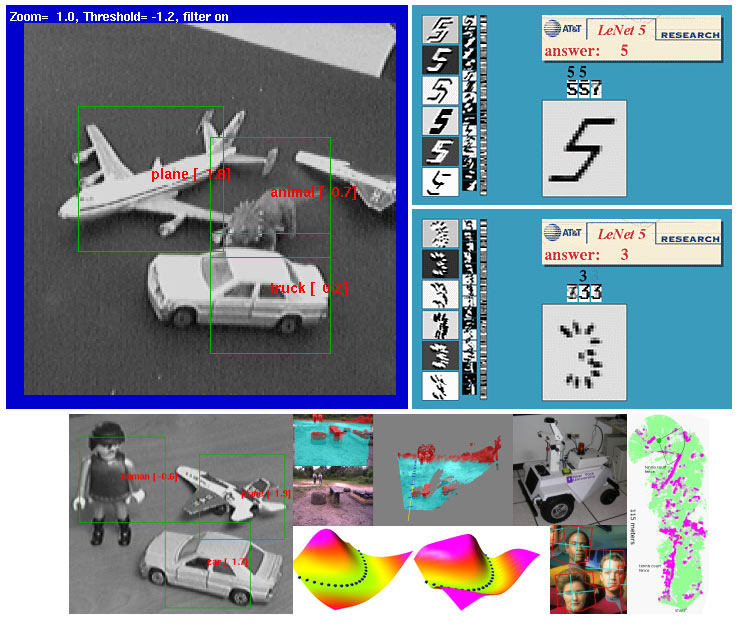

Hebbiano principas mažiau susijęs su objektų atpažinimu ir labiau susijęs su neuroninių tinklų dalies mokymusi ar mokymu. Neuromoksle šis principas dažnai apibendrinamas kaip „Ląstelės, kurios dega kartu, jungiasi kartu“. Ląstelės, žinoma, yra neuronai. Šio principo taikymas dirbtiniams neuroniniams tinklams iš esmės reiškia, kad programinė įranga, pagrįsta šiuo algoritmu, galėtų išmokyti save, laiku pagerėti.

Ekrano nuotrauka paimta iš http://yann.lecun.com/

„Google“ įsigijimai, susiję su dirbtiniu intelektu ir vaizdų supratimu

„Google“ jau pati sukūrė kai kurias iš šių technologijų; kiti, pavyzdžiui, Andrew Ng architektūra, ją įgijo. Taip pat verta atkreipti dėmesį į „Google“ augimo strategiją, tuo pačiu leidžiant rinkai augti, paliekant daugelį jos sprendimų atviro kodo kitiems tobulinti (kam slopinti konkurenciją, kai galite sau leisti išpirkti konkurenciją?)

Vis dėlto vienas įdomiausių įsigijimų yra „ DeepMind“ , investuojanti 400 milijonų dolerių. Kodėl „Google“ turėtų atlikti tokį didelį pirkimą? galite pagalvoti.

Labai tikėtina, kad šis konkretus įsigijimas, kurio tikslas yra įtraukti kvalifikuotus ekspertus, o ne konkrečius produktus, žymiai pagreitina „Google“, „Facebook“ ir kitų interneto firmų pastangas monopolizuoti didžiausias dirbtinio intelekto tyrimų smegenis. Žinoma, tai tik prielaida . Vis dėlto, norėdami geriau suprasti šį klausimą, labai rekomenduojame pažiūrėti žemiau pateiktą vaizdo įrašą, kuriame gausite labai iliustruotą vaizdą apie tai, koks iš tikrųjų yra „Google“ ir kaip jis veikia mūsų kasdienį gyvenimą.

Išvada

Žmonių sugebėjimas atpažinti tūkstančius objektų kategorijų netvarkingose scenose, nepaisant pozos kintamumo, apšvietimo pokyčių ir sąkandžių, yra viena iš labiausiai stebinančių vizualinio suvokimo galimybių, kurios vis dar neprilygsta kompiuterio regėjimo algoritmai. Arba bent jau tai, ką straipsnis nuo 2007 nurodyta. Štai po poros metų mes susiduriame su situacija, kai paieškos sistemos kasdien ketina įdiegti automatinį objektų atpažinimą. Dar daugiau „Google“ jau žengia į priekį, nes nuo 2012 m. Ji turi automatinio didelio masto vaizdo objektų atpažinimo patentą .

Natūralūs rezultatai gali atrodyti ne taip, kaip šiandien, ir netrukus bus padaryta svarbių patobulinimų. „Google“ pereina nuo „eilučių prie dalykų“, nes žinių diagrama bus visiškai integruota paieškos srityje. Algoritmai taip pat keisis ir jie tikriausiai bus labiau susiję su tikraisiais turinio subjektais ir kaip šie objektai yra susieti.

Tiesa, tik laikas ir kontekstas įrodys mus neteisingai ar teisingai. Dalykus galima suprasti tik atgal; bet jie turi būti gyvenami į priekį.

NuotraukosVaizdų skaitymas ir objektų atpažinimas vaizduose yra svarbi užduotis ir iššūkis apdorojant vaizdus ir matant kompiuterį. Paprasta „automatinio objektų atpažinimo“ paieška „Google“ mokslininke suteiks jums ilgą straipsnių sąrašą, kuriame pateikiamos įvairiausios sudėtingos lygtys ir algoritmai, pradedant 90-ųjų pradžia iki dabar. Tai reiškia, kad ši tema nuo pat paieškos pradžios buvo labai intriguojanti šios srities tyrinėtojus, tačiau vis dar yra darbas, kuris, atrodo, vyksta.

Ne taip seniai mes jus įtraukėme į „Google“ vaizdų paieškos pasaulį, atlikdami išsamų atvejo tyrimą . Tada mes bandėme išsiaiškinti, ar „Google“ gali nuskaityti tekstą iš vaizdų ir kokia šio dalyko reikšmė SEO pasauliui. Grįžome su įdomiais tyrimais tame pačiame „vaizdų paieškos“ lauke, kuriame bandoma atkreipti dėmesį į „Google“ pažangą šioje srityje ir į tai, kaip SEO specialistas turėtų neatsilikti, kad ateityje būtų geresnis reitingas.

Ateitis priklauso tiems, kurie jai šiandien yra pasirengę! Artimiausiu metu „Google“ tikriausiai pakeis algoritmus, susijusius su vaizdų reitingavimu, pokyčius, kurie dramatiškai paveiks paiešką, taigi ir SEO pasaulį.

Tai nėra menkas algoritmo pakeitimas, apie kurį kalbame, vienas iš tų, kurie daro įtaką tik nedidelei paieškos daliai. Ar kito lygio vaizdų paieškos karta, su kuria susidursime? Tai neabejotinai bus sėkminga paieškos pramonės pažanga, tačiau tikroji sėkmė bus tiems, kurie žengė žingsnį į priekį ir jau buvo pasirengę šiems dideliems pokyčiams.

Kodėl skaitmeninės rinkodaros bendruomenei objektų atpažinimas vaizduose yra svarbus?

Dienos pabaigoje viskas priklauso nuo reitingų.

Objektų aptikimas vaizduose pridės papildomą reitingavimo signalų sluoksnį, kurio negalima lengvai pakeisti.

Vaizdas su mėlynu šunimi bus vertinamas pagal su mėlynu šunimi susijusį raktinį žodį, o ne pagal raudoną šunį. Tai turi dvi svarbias pasekmes SEO pramonei:

1. Ieškant konkretaus raktinio žodžio pasirodys mažesnis klaidingų teigiamų žodžių skaičius, atsižvelgiant į tai, kas iš tikrųjų yra paveikslėlyje.

2. Be to, jis gali būti naudojamas susieti puslapio turinį su tikruoju vaizdu be jokių kitų išorinių veiksnių. Jei puslapyje yra daug mėlynų šunų nuotraukų ir įvairių kitų dalykų, susijusių su šunimis, tai automatiškai sustiprina to puslapio, kuriame kalbama apie šunis, reitingą.

Vis dėlto gali kilti klausimas:

Ar tai gali būti nauja objektų užpildymo vaizdais era kaip šešėlinė SEO technika?

Nemanau, nes šiais laikais algoritmai yra gana pažangūs, kad būtų galima aptikti tokio pobūdžio šlamštą. Tačiau tai neabejotinai naujos kartos paieškos, apie kurias kalbame, kurios gali sukelti didelių pokyčių ir iššūkių SEO pasaulyje.

„Google“, dirbtinis intelektas ir vaizdų supratimas

Vaizdo supratimas yra gana didelis dalykas visiems, todėl vizualinio atpažinimo iššūkis egzistuoja nuo 2010 m. Jis vadinamas „ ImageNet Large Scale Vision Recognition Challenge“ (arba ILSVRC) ir yra puikus pavyzdys, kaip konkurencija skatina pažangą. ILSVRC yra trys pagrindiniai takeliai : klasifikacija, klasifikacija su lokalizacija ir aptikimas. Tai reiškia, kad algoritmai, kurie yra įvesti į šį ginčijamą objektą, yra tikrinami atsižvelgiant į tai, ar jie gerai atpažįsta objektus tam tikrame paveikslėlyje, ir tai, ar jie „supranta“, kur objektas yra paveikslėlyje.

Kad būtų pasiektas aukštesnis našumas aptikimo iššūkyje, pramonė reikalauja daugiau nei komentuoti vaizdą „ etikečių maišeliu “, tikėdamasi, kad kažkas prilips.

Kad algoritmas galėtų sėkmingai atlikti šį iššūkį, jis turi sugebėti apibūdinti sudėtingą sceną tiksliai nustatydamas ir nustatydamas joje daug objektų. Tai reiškia, kad, atsižvelgiant į mopedu važiuojančio asmens nuotrauką, programinė įranga turėtų sugebėti ne tik atskirti kelis atskirus objektus (pvz., Mopedą, asmenį ir šalmą), bet ir teisingai pastatyti juos į erdvę ir teisingai juos klasifikuoti. Kaip matome paveikslėlyje, atskiri daiktai yra teisingai identifikuoti ir klasifikuojami.

Ekrano nuotrauka paimta iš http://googleresearch.blogspot.ro/2014/09/building-deeper-understanding-of-images.html

Bet kuri paieškos sistema, turinti tokią galimybę, labai apsunkintų bandymą perduoti žmonėms, važiuojantiems mopedais, kaip „lenktynininkų, vairuojančių„ Porsche ““ nuotraukas, prikimšdama metaduomenų, kuriuose taip sakoma. Kaip matote toliau pateiktuose pavyzdžiuose, technologija yra gana pažangi ir bet kokia klaidinanti schema gali būti lengvai atskleista.

Ekrano nuotrauka paimta iš http://googleresearch.blogspot.ro/2014/09/building-deeper-understanding-of-images.html

Šiais metais „Google“ dalyvavo ILSVRC, kur laimėjo su savo komanda „GoogleLeNet“ ir padarė kodą atvirą šaltinį, kad galėtų juo pasidalinti su bendruomene ir greičiau plėtoti technologijas. Tai turi milžinišką reikšmę pažangos požiūriu, nes „ILSVRC 2014“ jau yra šimtus ir net tūkstančius kartų sudėtingesnė nei panašių objektų aptikimo iššūkis vos prieš 2 metus. Net per vienerius metus šių metų laimėjimas šiame konkurse, atrodo, yra daug didesnis nei praėjusiais metais: surinkti 60 658 nauji vaizdai ir visiškai anotuoti 200 objektų kategorijų, suteikiant 132 953 naujas aprišimo dėžės anotacijas, palyginti su 2013 m. . Tikiuosi, kad lygtyje nepateiksiu per daug duomenų, tai reiškia, kad 2013 m. Vaizdo skaičius buvo apie 395000, o tik po metų skaičius gerokai padidėjo iki maždaug 457000. Taip, tai skamba taip pat susukta ir įspūdingai kaip „Google“ duomenų centras, kurį galite pamatyti žemiau esančiame paveikslėlyje.

„Google“ duomenų centras

Šiemet laimėjęs algoritmas naudoja „ Distbelief“ infrastruktūrą, kuri ne tik labai kompleksiškai žiūri į vaizdus ir gali identifikuoti objektus, neatsižvelgiant į jų dydį ir padėtį paveikslėlyje, bet ir mokosi. Tai nėra pirmas ir vienintelis kartas, kai „Google“ sutelkia dėmesį į mašininio mokymosi technologijas, kad viskas būtų geriau. Praėjusiais metais Andrew Ng, Stanfordo universiteto Dirbtinio intelekto laboratorijos direktorius ir buvęs „Google“ darbo tyrimų grupės „Google X“ kviestinis mokslininkas, pasiūlė architektūrą, galinčią mokyti ir augti:

„Mūsų sistema per porą dienų gali mokyti 1 milijardą parametrų tinklų tik 3 mašinose ir mes parodome, kad naudojant tik 16 mašinų ji gali būti išplėsta į tinklus, turinčius daugiau nei 11 milijardų parametrų.“

„Google+“ jau naudoja objektų aptikimą vaizduose. „Google“ paieška Kitas?

Tiesą sakant, išmanusis vaizdo aptikimo algoritmas, pagrįstas konvoliuciniu neuroninio tinklo architektūra, „Google+“ jau naudojamas daugiau nei metus . Dalis „ImageNet“ iššūkyje pateikto kodo buvo naudojama paieškos sistemos algoritmams patobulinti ieškant konkrečių (tipų) nuotraukų, net jei jos nebuvo tinkamai paženklintos.

Neuroninio tinklo architektūra gyvuoja nuo 1990-ųjų, tačiau tik neseniai tiek modeliai, tiek mašinos yra pakankamai efektyvūs, kad algoritmai veiktų milijardus vaizdų vienu metu. Pažangą galima kiekybiškai įvertinti įvairiais būdais, tačiau atsižvelgiant į vartotojo patirtį, reikia nepamiršti kelių dalykų:

1. Pirma, „Google“ algoritmas įrodė, kad gali pritaikyti objektus iš žiniatinklio vaizdų (iš arti, dirbtinę šviesą, išsamią) su objektais iš nestadijuotų nuotraukų (vidurio žemė, natūrali šviesa su šešėliais, įvairaus lygio detalės). Gėlė atrodė tiek pat gėlė pagal bet kokią kitą skiriamąją gebą ar apšvietimo sąlygas.

2. Be to, didžiajam G pavyko nustatyti keletą labai specifinių vaizdinių klasių, išskyrus bendrąsias. Tai ne tik nustatė daugumą gėlių kaip gėles, bet ir tam tikras specifines gėles (pvz., Hibiską ar jurginą).

3. „Google“ algoritmai taip pat sugebėjo gerai susitvarkyti su abstraktesnėmis objektų kategorijomis, atpažindami sąžiningą ir įvairų skaičių nuotraukų, kurias, pavyzdžiui, galima būtų priskirti „šokiui“, „valgiui“ ar „bučiniui“. Tam reikia daug daugiau, nei paprasčiausiai aptikti apelsiną kaip apelsiną.

Ekrano nuotraukos paimtos iš http://googleresearch.blogspot.ro/2013/06/improving-photo-search-step-across.html

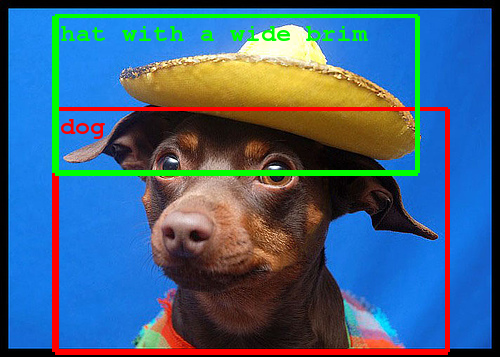

4. Taip pat buvo gerai elgiamasi su įvairiarūšės išvaizdos klasėmis. „Automobilis“ nebūtinai yra abstrakti sąvoka, tačiau gali būti šiek tiek keblu. Ar tai automobilio nuotrauka, jei galime pamatyti visą automobilį? Ar automobilio vidus vis dar yra automobilio vaizdas? Mes sakytume „taip“ ir atrodo, kad atrodo ir naujasis „Google“ algoritmas.

5. Naujasis modelis nėra be nuodėmės. Tai daro klaidų. Tačiau svarbu pažymėti, kad net kalbant apie klaidas, jos rodo pažangą. Atsižvelgiant į tam tikrą kontekstą, tikslinga suklaidinti asilo galvą su šuns galva. Arba šliužas gyvatei. Net ir per klaidą dabartinis „Google“ algoritmas viršija ankstesnius algoritmus.

Ekrano nuotraukos paimtos iš http://googleresearch.blogspot.ro/2013/06/improving-photo-search-step-across.html

Ar „Google“ žinių diagrama ir vaizdų aptikimas yra „santuoka“?

Kad ir koks įspūdingas yra naujasis „Google“ modelis, jis dar įspūdingesnis yra tai, kad tai tik dalis didesnio mokymosi mašinų paveikslo, puikiai integruoto su jau įspūdingu savo paties žinių grafiku. Pastarųjų pagrindą sudarančios „esybės“ taip pat padeda formuoti vaizdo aptikimo algoritmo klasifikavimo ir aptikimo galimybes. Kiekvienam objektui ir objektų klasei suteikiamas unikalus kodas (taigi, pavyzdžiui, jaguaro – gyvūno niekada negalima supainioti su „Jaguar“ – automobiliu), tada jis naudojamas padėti algoritmui mokytis, suteikiant jam žinių bazę kurį išbandyti jo bandymus.

„Google“ paverčia paiešką tuo, kas supranta ir paverčia jūsų žodžius ir vaizdus realaus pasaulio objektais, apie kuriuos kalbate.

Teisingai! Tai ne tik generuoja rezultatus pagal konkrečius žodžius ar vaizdus, bet ir tikrai „supranta“ jus.

Ekrano nuotrauka paimta iš http://googleresearch.blogspot.ro/2013/06/improving-photo-search-step-across.html

Kaip objektų aptikimas vaizduose gali paveikti jūsų SEO

Šie technologiniai laimėjimai leis mums dar geriau suprasti vaizdus, o pažanga yra tiesiogiai perduodama „Google“ produktams, pvz., Nuotraukų paieškai, vaizdų paieškai, „YouTube“, savaime vairuojantiems automobiliams ir bet kur, kur naudinga suprasti, kas yra paveikslėlyje. taip pat kur viskas yra. @GoogleResearch

Ekrano nuotrauka paimta iš http://googleresearch.blogspot.ro/2014/09/building-deeper-understanding-of-images.html

Kalbant apie paprastą SEO, šis žingsnis yra didžiulis ir jis padės sustiprinti „Google“ viziją apie SEO, pagrįstą turinio kokybe. Kaip vis sunkiau apgauti paieškos variklį naudojant įvairias susiejimo schemas, gali būti gana sunku apgauti ją netinkamai pažymėtomis nuotraukomis ar dideliu jų kiekiu. Geras turinys (ty kokybiški paveikslėliai, aiškiai identifikuoti objektai, aktualios nuotraukos) greičiausiai taps pakankamai svarbūs ir kalbant apie vaizdinius objektus.

Tikėtina, kad žymėjimas žymiai labiau priklausys nuo fotografijos kompozicijos, o ne rankinio ar dirbtinio ženklinimo. Jei norite, kad jūsų nuotrauka būtų rodoma, kai žmonės ieško „geltonojo šuns“ atvaizdų, jūsų SEO turėsite pradėti nuo to, kaip darote nuotrauką ir ką įdėjote į tą paveikslėlį.

Kaip iš tikrųjų veikia objektų aptikimas vaizduose

Jei dar to nepadarėte, laikas paimti kavos puodelį ir atsinešti mane, kol mes trumpai keliausime į „geekų teritoriją“.

Taigi, kuo ypatinga „DistBelief“ infrastruktūra? Tiesus atsakymas yra tas, kad tai leidžia mokyti neuroninius tinklus paskirstytu būdu ir yra grindžiamas Hebbiano principu ir masto nekintamumo principu .

Vis dar sumišęs? Taip, ten yra supakuota daug matematikos, tačiau ją galima išpakuoti paprastesniu lygiu. Neuroniniai tinklai iš tikrųjų nurodo tai, ko jūs galėtumėte tikėtis – kaip mūsų smegenyse yra laidai. Taigi, kalbėdami apie juos, mes iš tikrųjų turime omenyje dirbtinius neuroninius tinklus (ANN), kurie yra skaičiavimo modeliai, pagrįsti mokymosi ir modelio atpažinimo idėjomis – turi prasmę kontekste, apie kurį kalbame, tiesa? Toliau pateiktas pavyzdys, kaip veikia objektų aptikimas, gali šiek tiek apšviesti šį gana sunkiai suprantamą lauką.

„GoogLeNet“ naudojo tam tikrą ANN tipą, vadinamą konvoliuciniu neuroniniu tinklu, kuris pagrįstas idėja, kad atskiri neuronai reaguoja į skirtingus (bet sutampančius) regėjimo lauko regionus ir kad juos galima iškloti plytelėmis, kad gautų sudėtingesnį vaizdą. Grubiai supaprastinti – tai šiek tiek panašu į darbą su sluoksniais. Viena iš konvoliucinio neuroninio tinklo privilegijų yra ta, kad jis labai palaiko vertimą. Matematikoje vertimas gali reikšti bet kokį objekto judėjimą iš vienos vietos į kitą. Taigi, jei mes sujungsime viską, ką žinome iki šiol, „Netikėjimas“ gana gerai atpažįsta objektą, kad ir kur jis būtų įdėtas į tam tikrą paveikslą. Tai gali padaryti ir daugiau. Skalės nekintamumas taip pat yra matematinis principas ir iš esmės jis teigia, kad objektų savybės nesikeičia, jei ilgio skalės padauginamos iš bendro koeficiento. Tai reiškia, kad „Netikėjimas“ turėtų gerai mokėti atpažinti apelsiną, neatsižvelgiant į tai, ar jis yra toks pat didelis kaip jūsų ekranas, ar toks mažas, kaip piktograma: jis vis tiek bus oranžinis ir bus pripažintas tokiu (taip, apelsinams!

Ekrano nuotrauka paimta iš http://deeplearning.net/tutorial/lenet.html

Hebbiano principas mažiau susijęs su objektų atpažinimu ir labiau susijęs su neuroninių tinklų dalies mokymusi ar mokymu. Neuromoksle šis principas dažnai apibendrinamas kaip „Ląstelės, kurios dega kartu, jungiasi kartu“. Ląstelės, žinoma, yra neuronai. Šio principo taikymas dirbtiniams neuroniniams tinklams iš esmės reiškia, kad programinė įranga, pagrįsta šiuo algoritmu, galėtų išmokyti save, laiku pagerėti.

Ekrano nuotrauka paimta iš http://yann.lecun.com/

„Google“ įsigijimai, susiję su dirbtiniu intelektu ir vaizdų supratimu

„Google“ jau pati sukūrė kai kurias iš šių technologijų; kiti, pavyzdžiui, Andrew Ng architektūra, ją įgijo. Taip pat verta atkreipti dėmesį į „Google“ augimo strategiją, tuo pačiu leidžiant rinkai augti, paliekant daugelį jos sprendimų atviro kodo kitiems tobulinti (kam slopinti konkurenciją, kai galite sau leisti išpirkti konkurenciją?)

Vis dėlto vienas įdomiausių įsigijimų yra „ DeepMind“ , investuojanti 400 milijonų dolerių. Kodėl „Google“ turėtų atlikti tokį didelį pirkimą? galite pagalvoti.

Labai tikėtina, kad šis konkretus įsigijimas, kurio tikslas yra įtraukti kvalifikuotus ekspertus, o ne konkrečius produktus, žymiai pagreitina „Google“, „Facebook“ ir kitų interneto firmų pastangas monopolizuoti didžiausias dirbtinio intelekto tyrimų smegenis. Žinoma, tai tik prielaida . Vis dėlto, norėdami geriau suprasti šį klausimą, labai rekomenduojame pažiūrėti žemiau pateiktą vaizdo įrašą, kuriame gausite labai iliustruotą vaizdą apie tai, koks iš tikrųjų yra „Google“ ir kaip jis veikia mūsų kasdienį gyvenimą.

Išvada

Žmonių sugebėjimas atpažinti tūkstančius objektų kategorijų netvarkingose scenose, nepaisant pozos kintamumo, apšvietimo pokyčių ir sąkandžių, yra viena iš labiausiai stebinančių vizualinio suvokimo galimybių, kurios vis dar neprilygsta kompiuterio regėjimo algoritmai. Arba bent jau tai, ką straipsnis nuo 2007 nurodyta. Štai po poros metų mes susiduriame su situacija, kai paieškos sistemos kasdien ketina įdiegti automatinį objektų atpažinimą. Dar daugiau „Google“ jau žengia į priekį, nes nuo 2012 m. Ji turi automatinio didelio masto vaizdo objektų atpažinimo patentą .

Natūralūs rezultatai gali atrodyti ne taip, kaip šiandien, ir netrukus bus padaryta svarbių patobulinimų. „Google“ pereina nuo „eilučių prie dalykų“, nes žinių diagrama bus visiškai integruota paieškos srityje. Algoritmai taip pat keisis ir jie tikriausiai bus labiau susiję su tikraisiais turinio subjektais ir kaip šie objektai yra susieti.

Tiesa, tik laikas ir kontekstas įrodys mus neteisingai ar teisingai. Dalykus galima suprasti tik atgal; bet jie turi būti gyvenami į priekį.

Nuotraukos